GEN2 Runway 官网:【点击进入】

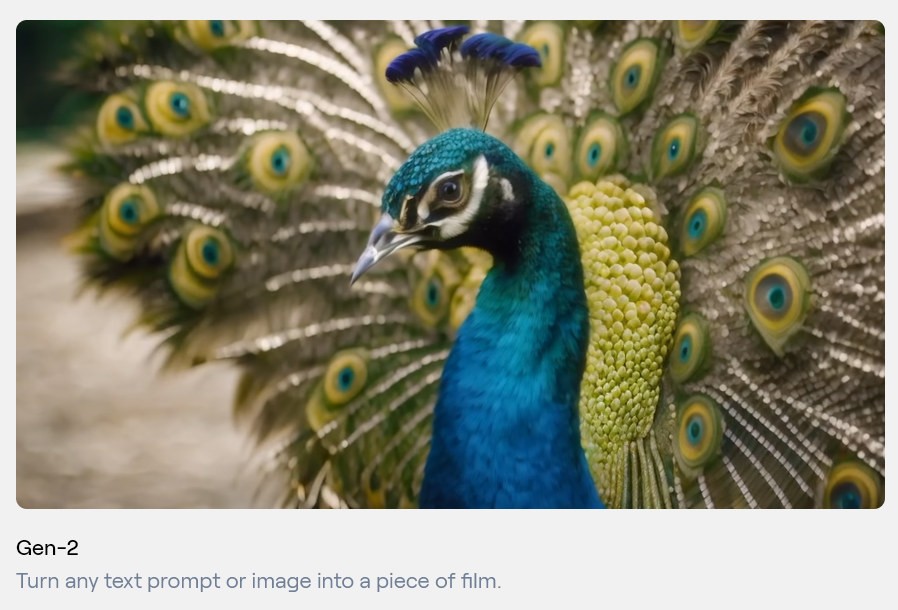

gen-2是Runway旗下的视频编辑器。该软件可以直接使用单个文本提示生成视频场景。

Gen-2模型具有使用文本提示即可以修改视频的艺术风格,直接使用单个文本提示生成视频场景等功能。

参考

和很多文生图类应用不同,Runway 的 Gen-1、Gen-2 挑战的是一项更有难度的事情 —— 视频编辑和生成。其中,Gen-2 不仅可以像 Gen-1 一样在原视频的基础上编辑出符合用户要求的视频,还可以从头生成视频。但遗憾的是,在最初发布时,Gen-2 只能在有限的候补名单中使用。

Gen-1 视频编辑效果。来源:https://twitter.com/runwayml/status/1681335709850824704

Gen-2 视频生成效果。来源:https://twitter.com/javilopen/status/1683493099450793984

不过,这一限制在今天被彻底打破。刚刚,Runway 宣布,Gen-1 和 Gen-2 已经彻底开放,任何人都可以注册一个账号免费尝试。生成的视频长度为 4 秒,每秒消耗 5 个积分,利用免费额度可以生成二十几个视频。如果免费积分耗尽,付费标准为 0.01 美元 / 积分,也就是生成一个视频需要 0.2 美元。

这一限制的解除让已经发布数月的 Gen-2 再度走红,越来越多的人晒出了自己的试用结果。在欣赏网友的大作之前,我们先看看这个应用能做什么。

刷屏的 Gen-2 到底能做什么?

今年 2 月份,Runway 发布了 Gen-1。它的功能非常丰富,包括风格化、故事版、蒙版、渲染、自定义等等。

风格化可以理解为参考某张图像修改视频风格。比如给出以下原始视频:

再给定一张参考图像:

Gen-1 就能将视频编辑成上述图像的风格:

故事版是一个电影学名词,指在影片的实际拍摄或绘制之前,将剧本的文字描述转换成一格一格叙述故事进展的图画。Gen-1 可以将一个类似故事版的视频转换为具有特定场景的视频。

蒙版(mask)可以理解为修改视频中的指定部分,而其他部分保持不变。比如,给定以下原始视频:

然后向 Gen-1 输入文字指令「白毛上有黑点的狗。」我们就可以得到编辑后的视频。

渲染是指将计算机生成的 3D 场景或特效图像转换成最终影像。比如,给定以下原始视频:

Gen-1 可以生成渲染后的视频:

此外,Gen-1 还支持自定义视频编辑:

今年 3 月份发布的 Gen-2 延续了这些功能,可以将图片或文本提示的构图和风格应用于原视频上。同时,它还新增了文字、图片生成视频功能。也就是说,仅需输入文字、图像或文字加图像的描述,Gen-2 即可在很短的时间内生成相关视频。它是市场上第一个公开可用的文本到视频模型。

比如,我们输入一段纯文字:「午后的阳光透过纽约阁楼的窗户照进来。」Gen-2 会直接「脑补」出视频:

输入一张照片 + 文字「低角度镜头:一个男人走在街上,被他周围酒吧的霓虹灯照亮。」

Gen-2 会返回以下结果:

仅输入一张图像,Gen-2 也可以将其扩展为视频:

目前,Runway 已经开放了网页端的免费体验窗口,相关应用(RunwayML)也已经在苹果的应用商店上线。

官网地址:https://research.runwayml.com/gen2

Gen-2+Midjourney = 无限可能

Gen-2 限制的解除让这款应用在社交媒体再次刷屏,网友纷纷晒出了自己的试用效果:

视频来源:https://twitter.com/dr_cintas/status/1683473643462860808

视频来源:https://twitter.com/LiveBetween2B/status/1682477648533151744

还有不少人尝试将此前大火的文生图模型 Midjourney 与 Gen-2 结合在一起使用,生成效果非常惊艳:

视频来源:https://twitter.com/commonstyle/status/1682874851823058946

如何再结合一些语音合成、编辑软件,直接用来制作电影也不是不可能:

视频来源:https://twitter.com/dr_cintas/status/1683473643462860808

有人已经用这些工具做出了一部虚构电影的预告片。

未来,这些工具还有哪些潜力?我们拭目以待。