云安全初创公司 Wiz 的研究人员报告了一起发生在微软 AI GitHub 存储库上的数据泄露事件,其中包括 3 万多条内部 Microsoft Teams 消息的泄露;而这一切都是由一个配置错误的 SAS 令牌所引起。

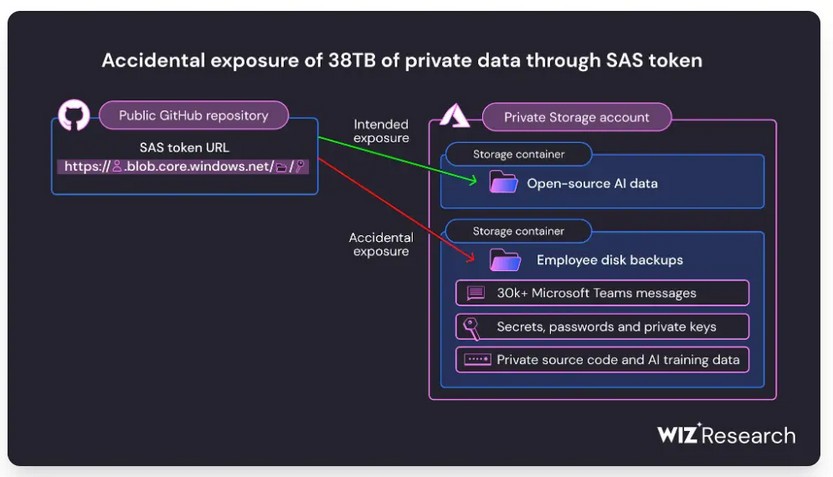

Wiz 指出,数据泄露源于微软人工智能研究小组下的一个名为 robust-models-transfer 的仓库;该存储库包含可用于构建新神经网络的图像识别模型和训练数据集。此次泄露是由其中一个训练数据文件引起的,该文件托管在 Azure 存储帐户中。微软方面原本打算仅公开共享 AI 训练数据集,但意外地开放了对包含该数据集的整个 Azure 存储帐户的访问权限。

研究人员在扫描后发现,配置错误的帐户导致了 38 TB 的微软内部文件泄露,其中包括两名员工工作站的磁盘备份。这些备份包含敏感的个人数据,涵盖 Microsoft services 的密码、密钥以及来自 359 名微软员工的 30,000 多条内部 Microsoft Teams 消息。

且除了过于宽松的访问范围之外,令牌还被错误配置为允许 “完全控制” 权限而不是只读权限。这意味着,攻击者不仅可以查看存储帐户中的所有文件,还可以删除和覆盖现有文件。

不过研究人员指出,此存储帐户并未直接向公众公开,而是一个私有存储帐户。“微软的开发人员使用了一种名为 SAS tokens 的 Azure 机制,该机制允许创建一个可共享的链接,授予对 Azure 存储账户数据的访问权限 -- 而经过检查,该存储账户看起来仍然是完全私有的。”

Wiz 最初于 6 月 22 日发现了该问题,并在不久后向微软报告。6 月 24 日,微软宣布撤销 SAS 令牌,并于 8 月 16 日完成了潜在影响的内部调查。

报告总结称,共享人工智能数据集这一简单步骤却导致了重大数据泄露,根本原因在于使用了账户 SAS 令牌作为共享机制。由于缺乏监控和管理,SAS 令牌存在安全风险,应尽可能限制其使用。“这些令牌很难跟踪,因为微软没有在 Azure 门户中提供集中管理这些令牌的方法。此外,这些令牌可以配置为永久有效,没有过期时间上限。因此,将账户 SAS 令牌用于外部共享是不安全的,应避免使用。”

并建议组织提高人工智能开发过程的相关安全风险意识,确保安全团队与数据科学和研究团队密切合作,以确保定义适当的防护栏。